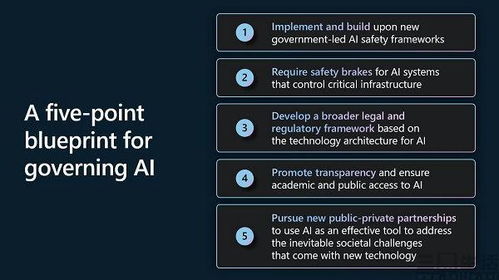

近日,微软正式发布一份关于人工智能治理的研究报告,针对人工智能基础软件开发提出系统性建议。随着人工智能技术在各个领域的深入应用,其基础软件的稳定性、安全性和伦理合规性已成为行业发展的关键议题。

报告指出,当前人工智能基础软件开发面临三大核心挑战:首先是技术透明度的缺失,许多深度学习模型存在'黑箱'问题,导致决策过程难以追溯;其次是数据隐私保护机制不完善,训练数据可能包含敏感信息;第三是算法偏见难以避免,可能放大社会不平等现象。

针对这些问题,微软提出四点治理建议:

第一,建立开源协作机制。鼓励企业、学术机构和开源社区共同参与基础软件开发,通过透明化开发流程提升软件质量。

第二,实施全生命周期监管。从需求分析、设计开发到部署运维,每个阶段都应设立明确的安全标准和伦理审查。

第三,构建多方参与的治理框架。政府监管部门、行业组织、技术专家和公众代表应共同制定治理规则。

第四,加强开发者伦理培训。将负责任创新理念融入人才培养体系,确保开发人员具备必要的伦理判断能力。

值得注意的是,报告特别强调基础软件在人工智能生态系统中的核心地位。作为支撑各类AI应用的底层平台,基础软件的质量直接影响整个技术体系的可靠性和安全性。因此,微软建议各国政府将AI基础软件纳入关键信息基础设施保护范围,同时推动建立国际通用的技术标准和认证体系。

报告认为健全的治理机制将促进人工智能技术的可持续发展。通过建立信任、确保安全、维护公平,人工智能基础软件才能真正成为推动社会进步的有力工具。微软表示将继续与各方合作,共同构建负责任的人工智能开发生态系统。